一、原文信息

标题: Meta's AI Watermarking Plan Is Flimsy, at Best

中文译名: Meta的AI水印计划脆弱不堪

作者: David Evan Harris(加州大学伯克利分校)、Lawrence Norden(纽约大学法学院)

发表日期: 2024年3月5日

发表期刊: IEEE Spectrum

二、原文全文翻译

Meta的脆弱AI水印计划无法拯救民主

在过去几个月里,我们目睹了乔·拜登的深度伪造语音电话,鼓励新罕布什尔州选民"把选票留到11月大选",还有泰勒·斯威夫特对唐纳德·特朗普的虚假背书。显然,2024年将成为美国历史上第一个"AI选举"年。

随着许多倡导者呼吁建立保障措施来防范AI对我们民主制度的潜在危害,Meta(Facebook和Instagram的母公司)在上个月自豪地宣布,它将对使用最流行的生成式AI工具创建的AI生成内容进行标记。该公司表示,它正在"构建能够大规模识别不可见标记的行业领先工具——特别是C2PA和IPTC技术标准中的'AI生成'信息。"

不幸的是,社交媒体公司今年不会通过这种方法解决社交媒体上的深度伪造问题。事实上,这项新举措对解决AI生成材料污染选举环境的问题几乎无济于事。

最明显的弱点是,Meta的系统只有在制造深度伪造的不良行为者使用已经在其图像中放入水印的工具时才能发挥作用——也就是说,关于数字内容来源的隐藏或可见信息。大多数不安全的"开源"生成式AI工具根本不产生水印。(我们使用"不安全"一词,并将"开源"加引号,是为了表示许多此类工具不符合开源软件的传统定义,但由于其底层代码或模型权重已公开,仍然构成威胁。)如果发布了包含水印的这些不安全工具的新版本,旧工具仍然可用,并能够生成无水印的内容,包括个性化和极具说服力的虚假信息以及未经同意的深度伪造色情内容。

我们还担心,即使不良行为者使用Meta声称将涵盖的AI工具,他们也可以轻易规避Meta的标记制度,这些工具包括来自谷歌、OpenAI、微软、Adobe、Midjourney和Shutterstock的产品。鉴于从使用当前这些公司已实施的C2PA水印标准生成的图像中移除水印只需要大约2秒钟,Meta承诺标记AI生成图像的做法就站不住脚了。

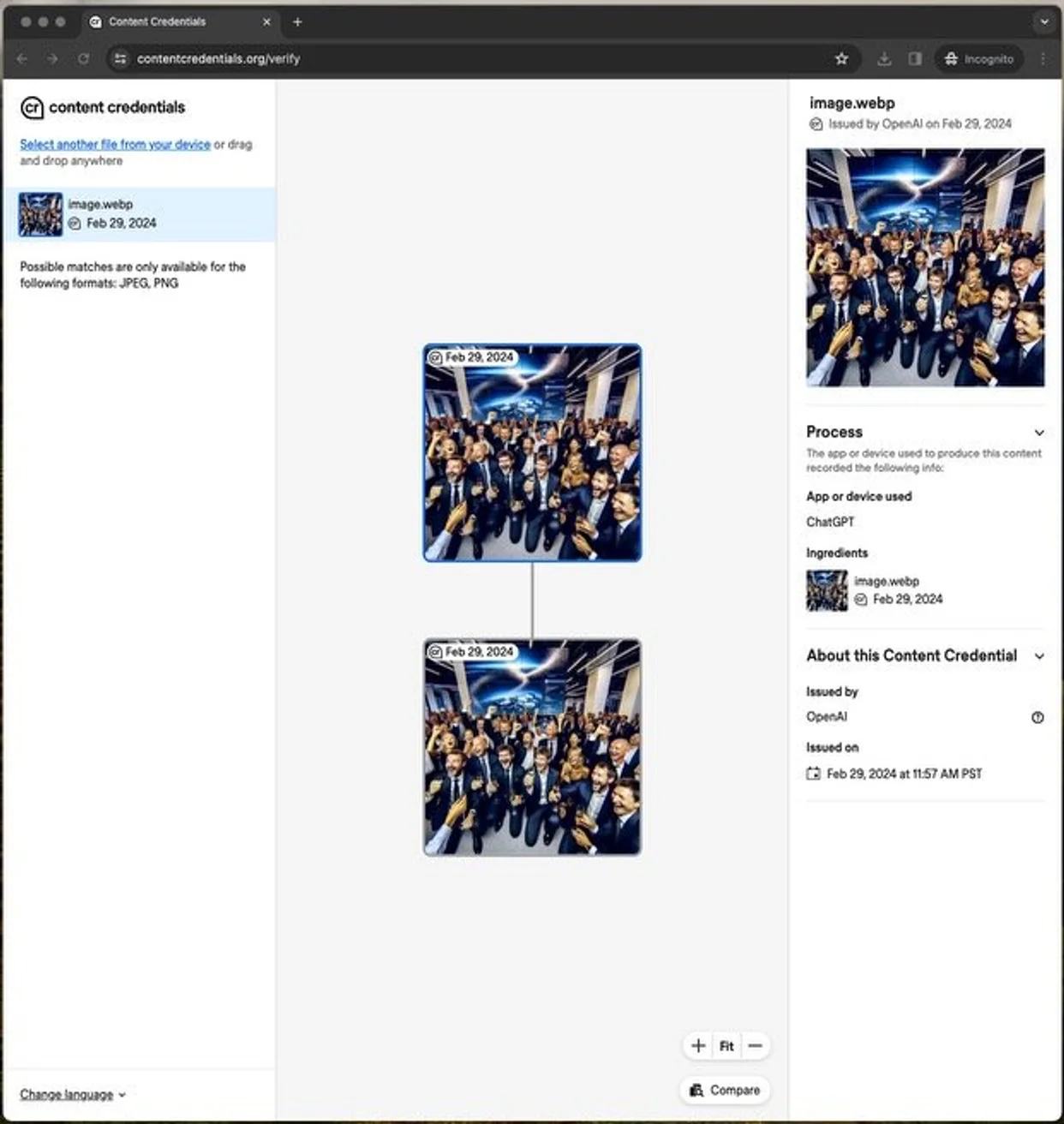

[图片说明:当作者将他们生成的图像上传到检查水印的网站时,该网站正确地指出这是由OpenAI工具生成的合成图像。]

我们知道这一点,是因为我们能够轻易地移除Meta声称将检测到的水印——而我们

![[机器学习]03-基于核密度估计(KDE)的鸢尾花数据集分类](http://pic.xiahunao.cn/[机器学习]03-基于核密度估计(KDE)的鸢尾花数据集分类)

=>TIM+DAC+ADC+DMA正弦波回环测试)