✳️ 引言:低空经济起飞,智能视觉链路成刚需基建

随着政策逐步开放与技术加速成熟,低空经济正从概念走向全面起飞。从载人 eVTOL 到物流无人机,从空中巡检机器人到城市立体交通调度平台,低空场景正在成为继地面交通和移动互联网之后的第三空间基础设施。

据工信部和民航局预测,到 2030 年我国低空经济年产值将突破万亿元,覆盖 电力巡检、应急响应、城市安防、农业遥感、物流配送、边境巡控等多个高频场景。然而,在这一系列场景中,除了飞行器本体之外,另一个关键能力正逐渐成为“成败分水岭”:

✅ 那就是——低延迟、稳定、智能可控的视频感知链路。

📡 为什么“视频链路”是低空系统的刚需?

-

无人系统不再靠人操作,而靠“看”与“判断”。

飞行器必须具备视觉认知能力,从而完成避障、识别、定位、跟踪等任务。 -

指挥控制系统必须“看得见”才能“控得准”。

无人机编队协作、城市低空交通调度等都依赖于画面流的实时同步与场景判断。 -

AI智能模型依赖高质量、低延迟的视频输入。

无论是边缘推理还是云端分析,视频都是最关键的输入源。

🎯 视频不再只是“看”,更是“算”“控”“判”的信息基础

在传统视频系统中,“看清画面”足矣;而在低空经济中,“画面是否同步”“延迟是否可控”“能否帧级接入AI识别”才是真正的核心指标。这就要求:

-

更低的传输时延(<200ms)

-

更强的跨平台部署适应能力

-

更开放的数据回调与解码接口

-

更高的抗网络抖动稳定性

这些,恰恰是传统播放器、通用流媒体方案难以胜任的。

在这样的背景下,一套能够稳定支撑“空中到地面”、“实时感知到智能响应”的端到端视频链路基础设施,已成为低空经济从可飞行到可调度、可协作、可智能的关键基石。

📌 这正是大牛直播SDK切入这一新兴产业的价值所在 —— 它不仅是一套播放器,更是一套可嵌入、可拓展、可演化的低空智能视觉通道系统内核。

🎯 场景挑战:低空经济中的视觉链路难题全景图

低空经济的快速发展正推动大量无人化飞行器进入城市、农村、海洋等复杂空域。这些飞行终端已不再是简单的“飞行平台”,而是承载智能感知、远程控制、协同作业的空中节点。

在这些实际应用中,“视频链路”不仅仅用于监看画面,它必须成为整个系统中实时决策、任务执行、智能交互的关键输入源。然而,当这一链路真正走向工业级部署时,工程上遇到的挑战远比“播放成功”复杂得多:

Android平台Unity共享纹理模式RTMP播放延迟测试

1️⃣ 延迟不可控:响应失时,任务精度下降

应用背景:

-

城市避障、目标识别等任务要求视频延迟 <150ms;

-

多无人机协同飞行时,画面同步需控制在帧级差异;

-

指挥控制系统依赖视频进行决策反馈,任何响应滞后都可能导致操作偏差。

技术挑战:

-

传统播放器为“稳定播放”而设计,默认缓冲延迟在 500ms~3s;

-

CDN、HTTP传输路径引入多层不可控延迟;

-

编码端缺乏灵活 GOP / I帧控制,导致首帧拉起慢、解码等待长。

2️⃣ 弱网多变:丢帧/卡顿频发,链路不稳定

应用背景:

-

无人机作业常位于山区、海域、林区,移动信号不连续;

-

城市楼宇间干扰严重,5G 回落现象频繁,视频中断风险大。

技术挑战:

-

TCP 传输一旦丢包需重传,出现“延迟叠加”效应;

-

开源播放器缺乏丢帧重组、动态自适应能力;

-

无断点续流机制,导致“卡顿即中断”。

3️⃣ 平台异构:多端部署,统一集成困难

应用背景:

-

飞行端通常为嵌入式 Linux,控制端可能是 Android,中心系统为 Windows 或 Linux;

-

同一系统需适配手机控制、PC调度、Web平台展示、Unity三维引擎渲染;

-

AI识别模块独立运行于边缘GPU主机,需接入原始帧流。

技术挑战:

-

大多数播放器为单平台构建,接口风格各异;

-

缺乏统一的播放控制、帧回调、渲染抽象机制;

-

开发者需针对每个平台重复实现流媒体集成逻辑,工程复杂度高。

4️⃣ 数据不可用:画面看得见,但不能被“AI使用”

应用背景:

-

目标检测、行为识别、异常分析等 AI 模块需实时获取 YUV/RGB 帧输入;

-

分布式 AI 模块需接收时间戳对齐的视频数据进行融合推理;

-

某些业务希望将画面与识别结果同时展示、记录与决策反馈。

技术挑战:

-

多数播放器无法暴露解码后的视频帧(仅提供渲染);

-

缺乏统一帧回调接口和时间戳输出,难以与模型做“时序对齐”;

-

视频链路与 AI 模块割裂,无法形成一体化闭环。

5️⃣ 控制闭环断裂:不能“看即判”“判即控”

应用背景:

-

巡检型无人机需边看边识别,边识别边发控指令;

-

大型系统中需支持多路切流、多任务调度、画面联动响应;

-

地面站与飞行端之间必须形成“任务事件驱动 + 视频反馈”链路。

技术挑战:

-

通用播放器无法暴露控制层接口,不能响应任务事件;

-

多流拉取/切换不具备同步控制机制,无法快速切画面、锁目标;

-

视频链路“只出不入”,无法参与系统级协同。

📌 小结:这些问题不是“技术细节”,而是“系统瓶颈”

传统视频链路方案(如 HLS + HTML5、CDN 分发 + 媒体播放器)设计初衷是为延迟不敏感、播放为主的内容消费场景服务。面对低空经济的以下新特征,它们显得力不从心:

-

⏱️ 对毫秒级时延的敏感性;

-

📶 对弱网适应能力的要求;

-

🧠 对 AI 可用性与可控性的依赖;

-

🧩 对多平台、多任务集成的需求。

这些挑战,不仅暴露了传统方案的“播放导向”局限,也明确了低空经济呼唤新型视频链路基础设施的迫切性。

✅ 视频链路,必须进化为“智能协同的核心能力”,而不是“视觉展示的附属组件”。

🚀 解决方案:用大牛直播SDK构建低空智能系统中的视频基础设施

在经历了从“看得见”到“控得动”、再到“判得准”的进化后,低空经济下的飞行终端正逐步成为空中的智能节点。而与之配套的,必须是一条端到端的可控制、可感知、可集成的视频数据链路。

Android平台RTSP播放器时延测试

Android平台RTMP直播播放器延迟测试

传统播放器无法胜任的核心原因,在于其本质上为内容消费而生。要解决低空任务中的种种痛点,必须从链路底层重新设计,构建具备以下能力的视频系统:

✅ 1. 架构理念:从“播放器”转向“智能视觉通道组件”

大牛直播SDK的设计原则不是“兼容所有格式”,而是为工程系统构建稳定可控的实时视觉通路:

-

解耦传统缓冲模型,支持“关键帧即播 / 收帧即解 / 渲染直通”;

-

原生暴露解码后 YUV / RGB 数据,可对接 AI 模型、同步控制系统;

-

封装统一播放内核 API,支持 Android / iOS / Windows / Linux / Unity 多平台统一部署;

-

提供主动控制接口(帧控制、时间戳同步、切流控制),支持系统级联动。

这不再是“播放器”,而是一个“支持智能任务控制的视频数据基础组件”。

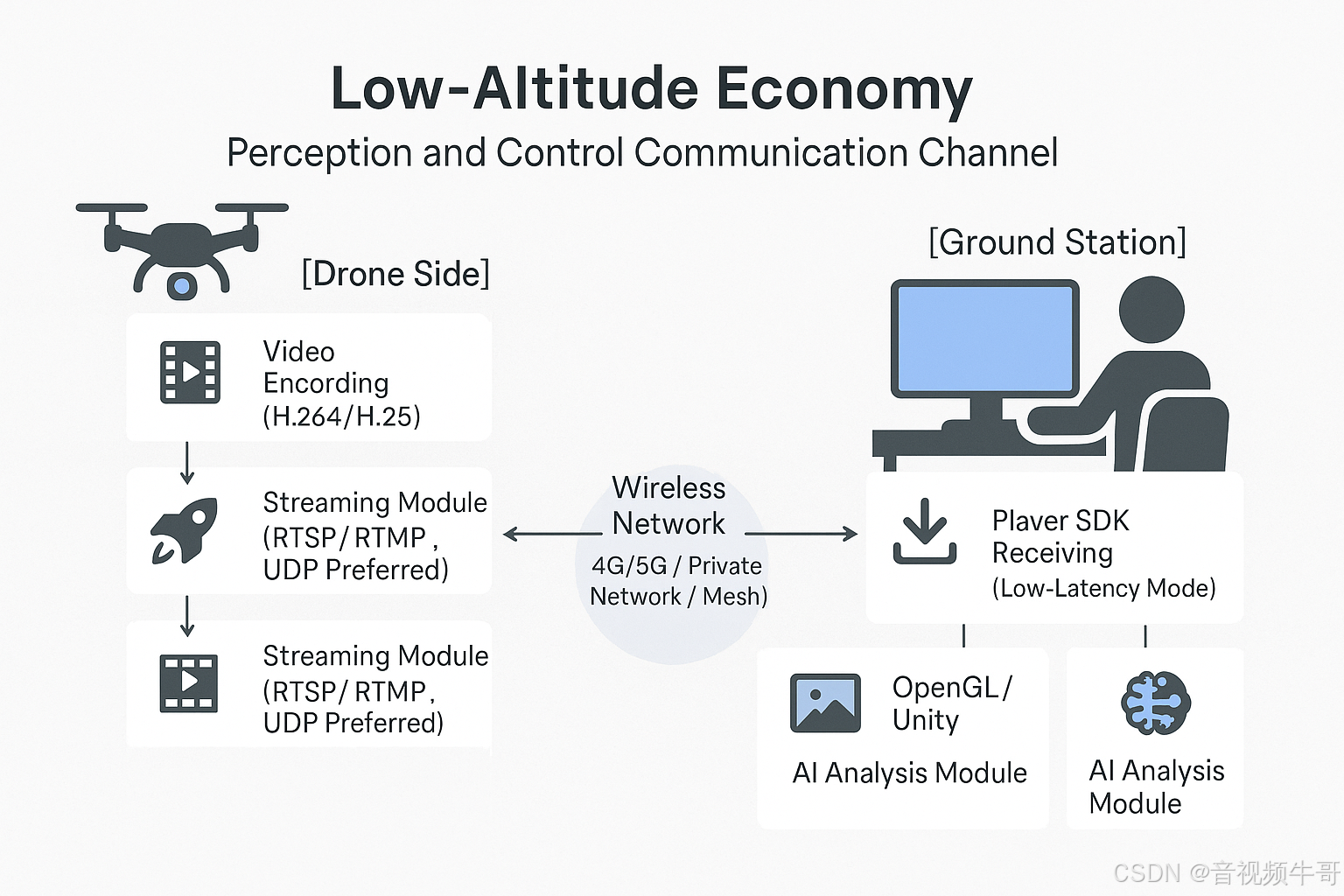

🔧 2. 系统架构设计:适配多类型无人终端与地面系统

大牛直播SDK可灵活嵌入各类飞行器、边缘盒子、地面控制站、云指挥系统中,构建从空中采集到智能感知的闭环链路:

📡 端到端系统链路结构:

【飞行端】

📷 摄像头采集

↓

🎞 编码模块(H.264/H.265)

↓

🚀 大牛SDK推流组件(RTSP/RTMP)

↓

📶 网络(UDP / TCP / 自组网 / 5G)【边缘/控制端】

📥 大牛SDK播放器组件

↓

🖼 渲染显示(OpenGL / Unity / Surface)

or

🧠 AI 模型分析模块(YUV / RGB 回调)【控制闭环】

↻ 控制系统 / 调度系统 / 人工操作界面

🧠 3. 核心技术机制:针对每个延迟源头逐一压缩

| 链路节点 | 技术优化 | 延迟控制能力 |

|---|---|---|

| 编码器侧 | 支持 GOP/I帧间隔设置、硬编优先 | 首帧生成速度快 |

| 推流传输 | 支持 RTSP TCP/UDP 自适应、RTMP 低延迟模式 | 传输延迟低 |

| 播放内核 | 首帧拉起即播、关闭缓冲池、无预解码等待 | 平均解码延迟低 |

| 渲染回调 | 支持 YUV/RGB 每帧回调 + 纹理加速渲染 | 可直接对接 OpenCV、YOLO 等模型 |

| 多路同步 | 支持并发拉流与切流控制 + 帧对齐 | 满足多终端调度需求 |

| 平台适配 | 同一播放核心跨 Android / Windows / Linux / Unity 等 | 无需额外移植成本 |

全链路可控制延迟压缩至 100-200ms 端到端,适用于高实时性任务(避障、识别、协同)。

🌐 4. 协议选型与场景匹配建议

| 场景 | 推荐协议 | 原因 |

|---|---|---|

| 局域网边缘节点(固定翼、地面站) | RTSP + UDP | 延迟最低,控制最精细,适合 AI 分析 |

| 弱网移动终端(手持站控) | RTSP + TCP | 可抗丢包,断点续播稳定 |

| 跨域远程调度中心 | RTMP + 自定义缓冲参数 | 兼容公网,支持转 CDN / 云展示 |

| 多终端并发接入 | RTSP 多实例播放 + 纹理同步 | 支持画面快速切换与多源协同 |

| AI模型接入需求 | 任何协议 + 帧回调接口 | YUV / RGB 帧直接对接模型或业务逻辑 |

📦 5. 模块化能力矩阵总览

| 能力模块 | 支持情况 | 说明 |

|---|---|---|

| RTSP/RTMP 播放 | ✅ | 支持裸码流,低延迟模式 |

| 多平台播放内核 | ✅ | Android / Windows / Unity / Linux 同一内核 |

| 视频回调接口 | ✅ | 支持 RGB/YUV 帧级数据回调 |

| 硬解 / 渲染接口 | ✅ | 支持 OpenGL、Unity 纹理绑定渲染 |

| 低延迟推流组件 | ✅ | 支持 I帧控制、码率控制、断点续推 |

| 控制指令对接 | ✅ | 支持时间戳输出与控制系统联动 |

✅ 小结:大牛直播SDK重构了“看-控-判”链路的技术基底

大牛直播SDK不是“用得方便”的播放器,而是“适合系统落地”的视觉链路中枢。

它不是“为了播放服务”,而是为了“支撑低空智能系统的感知、控制与判断”而构建。从工程角度,它解决了传统方案无法胜任的四大核心问题:

-

延迟可控

-

数据可用(供AI / 控制系统使用)

-

部署可扩展

-

协议可灵活组合

✅ 这是一套为“飞得更智能”而生的视觉链路解决方案。

✅ 它正成为新一代低空系统中的“视频基础设施模块”。

🛰️ 典型场景部署:大牛直播SDK在低空经济中的实战应用

低空经济涵盖了从民用到工业、从单机作业到空地协同的广泛任务类型。在不同应用场景中,视频链路的性能表现往往直接决定了作业效率、控制安全性和智能系统的可落地性。

以下是多个已知场景中,大牛直播SDK + RTSP/RTMP链路的典型部署方式与能力表现。

🚁 场景一:城市低空物流(eVTOL调度监控)

需求背景:城市低空无人机物流需搭建飞行状态监控平台,视频回传至调度中心 + 手持终端,用于任务态势感知与应急指挥。

| 要求 | 技术部署 |

|---|---|

| 视频回传实时性 < 200ms | 飞行器端内嵌 SDK 推流模块(RTMP 推至边缘节点) |

| 调度系统 Web 端可视化 | 边缘转 WebRTC / HTTP-FLV 播放,同时内部使用 SDK 播放器低延迟展示 |

| 多路航线并发调度 | 大牛直播SDK支持多路并发解码与画面切换 |

| 数据可用于识别风切/安全隐患 | 通过 YUV 帧回调接入轻量 AI 风场识别模型 |

🏭 场景二:智慧工业巡检(电力/化工厂区)

需求背景:无人机按预定路径巡航,检查变电站、塔杆、化工反应装置是否存在锈蚀、泄露、高温等异常,需同步视频与 AI 判图。

| 要求 | 技术部署 |

|---|---|

| 视频边飞边传,AI 实时分析 | 飞行端推 RTSP(轻量级RTSP服务),边缘终端用 SDK 拉流+帧回调 |

| 网络波动区域需保持连续画面 | SDK 自动切换 RTSP TCP / UDP,具备断点重连与缓冲清空机制 |

| 支持人工远程查看任一节点 | 调度台通过多实例播放器切换分路图像 |

| 识别结果与画面同步展示 | 使用时间戳机制回传 AI 判定点至界面 |

🚨 场景三:城市安防巡逻(夜间布控 / 高密人流监测)

需求背景:布控无人机搭载热成像或夜视摄像头,需低延迟直播画面至执法平台,支持目标跟踪、聚集检测、自动告警。

| 要求 | 技术部署 |

|---|---|

| 夜视画面低延迟、无闪断 | 使用大牛SDK推送 RTSP 裸流至边缘服务器,实时解码 |

| 多任务并行切流 | 支持 Android 移动终端同时切换多路任务画面 |

| AI辅助分析 | 接入人流密度 / 夜间行人检测模型,直接从 RGB 帧回调接入推理引擎 |

| 告警事件闭环 | SDK集成帧回调时间戳,支持警情定位标注与录像 |

🌉 场景四:大型基础设施空检(桥梁/高铁/输电线)

需求背景:飞行器巡检高精度目标(裂缝、腐蚀点、组件松动),并在现场做 AI 初筛识别,重要异常即刻回传控制台。

| 要求 | 技术部署 |

|---|---|

| 超高图像质量支持 | 支持 2K/4K H.265 编码视频推流,SDK端软硬解自动适配 |

| 延迟低于 150ms | GOP 控制为 10~15,首帧即播机制启用 |

| 工程师可一键录像 / 抓拍 / 标注 | 播放器内集成录像、快照 API,并支持 YUV 数据输出用于后处理 |

| 可拓展至AI质量检测模型 | 与 OpenCV + 结构识别模型联动,通过帧回调精准配图位置 |

🧠 总结:场景虽异,链路核心诉求一致

| 场景类型 | 视觉链路核心诉求 | 大牛直播SDK满足能力 |

|---|---|---|

| 城市物流 / 巡控 | 实时性 + 多终端接入 | 推拉流模块全平台支持,延迟可控 |

| 工业巡检 / 安防 | 弱网适应 + 智能分析 | TCP/UDP切换,YUV帧回调、AI可接入 |

| AI辅助决策 | 高帧画质 + 帧级处理能力 | 支持帧编号、时间戳输出、同步渲染 |

| 多任务调度 | 切换快 + 同步好 | 支持多路并发拉流 + 纹理渲染回调 |

✅ 不同的飞行器、终端系统与任务目标,映射出的其实是对“视频链路底层基础设施”的共同需求。

✅ 大牛直播SDK,以其模块化架构与低延迟能力,正在成为低空场景中“最轻量也最强大的视频神经组件”。

📦 模块能力矩阵与系统集成建议

✅ 能力矩阵总览:为“视频 × 智能”任务打造的系统级组件组合

| 模块类别 | 能力项 | 描述 | 工程价值 |

|---|---|---|---|

| 推流组件 | RTSP / RTMP 推流 | 支持 H.264 / H.265 编码,GOP/I帧可调 | 构建低延迟上行链路,适配无人端输出 |

| 音频采集与推送 | 支持麦克风 / 内录 / 多声道 | 可录任务语音或远程通话 | |

| 弱网重连机制 | 支持网络中断自恢复 | 适配山区、海面、复杂城域环境 | |

| 播放组件 | RTSP / RTMP 播放器 | 支持裸流、封装流,低缓冲延迟 | 多平台嵌入式播放,延迟 <200ms |

| 多实例拉流 | 单进程多路解码并发 | 支持“多画面协同”场景 | |

| OpenGL / Unity 渲染 | 支持 OES 纹理、贴图输出 | 可嵌入 3D 可视化引擎 | |

| AI对接能力 | 帧级 RGB/YUV 回调 | 每帧解码后送入分析模型 | 与 OpenCV / YOLO / TensorRT 等无缝联动 |

| 帧时间戳输出 | 支持同步 AI、导航、日志系统 | 可用于智能标注、事件对齐 | |

| 控制对接能力 | 快照 / 录像 / 状态回调 | 控制层直接调用 | 支持“看中即抓、控中即用” |

| 支持切流控制 | 动态切换数据源或视角 | 满足调度台、地面站任务切换 | |

| 部署适配 | 跨平台SDK | Android / iOS / Windows / Linux / Unity | 一套代码,多平台共用 |

| 编程语言支持 | C / C++ / Java / C# / Unity 脚本 |

📌 小结:组件化设计,系统级构建,工程化落地

与其说大牛直播SDK是一个视频播放库,不如说它是一个可插拔的低延迟视觉链路组件库,具备如下关键特征:

-

模块化 → 可选择性集成推流/播放/回调等功能;

-

系统化 → 不只是“能播”,还能控、能识别、能同步;

-

工程友好 → 多平台、跨语言、高度可控、可重构。

✅ 它让“视频”不再只是结果展示,而成为“系统感知与决策能力”的输入接口,成为构建智能化低空基础设施的关键组件。

🔚 结语与展望:让视频链路成为空天地一体系统的“感知基础设施”

在低空经济蓬勃发展的时代背景下,无人系统正从“可飞行”迈向“可调度、可协同、可智能”。以无人机为代表的飞行终端,不再只是物理载体,更成为信息的前线感知节点。它们的“眼睛”——视频链路,正承担起连接空域、地面与云端的关键使命。

🎯 视频链路,不再只是“看得清”,而是智能系统的第一感官

-

✅ 对系统而言,视频是触发 AI 推理与控制执行的感知源;

-

✅ 对人机协同而言,视频是完成远程监控与操控的界面支点;

-

✅ 对平台调度而言,视频是实现多任务编组与反馈决策的核心数据流。

换言之,视频不再是被动展示结果的“尾端组件”,而是主动触发任务执行的“中枢入口”。

🧠 视频基础设施的三个演进趋势:

| 传统视频系统 | 工业智能视频系统 | 空天地一体化“视频神经系统” |

|---|---|---|

| 仅支持播放展示 | 支持局部 AI 接入与控制协同 | 视频成为全局智能节点的感知接口 |

| 单端解码渲染 | 可对接 AI 模型 | 可跨平台、跨节点同步与推理 |

| 人为辅助查看 | 支持规则触发报警 | 支持任务闭环、自主协同判断 |

🚀 大牛直播SDK:在新一代“空地协同系统”中的角色定位

随着“空天地一体化”体系加速落地,未来将呈现出多平台协同感知、多任务调度联动、多智能节点并行决策的新生态。在这个过程中,大牛直播SDK的定位不再局限于“播放器”或“推流器”,而是:

✅ 一种跨平台、跨协议、可编程、可协同的视频链路基础设施层

它具备:

-

📡 对接飞行终端与地面系统的传感能力;

-

🧠 支撑边缘智能与云端 AI 分析的数据入口能力;

-

⚙️ 支持调度系统与指挥平台的任务可视化与闭环控制能力;

-

🧩 适配各种异构系统与操作环境的工程可用性。

换言之,大牛直播SDK 是低空经济的“视频管道层”,是多智能体感知体系的“视频神经层”,也是未来空地协同系统中的基础设施组件。

🌐 展望未来:从“低空感知”迈向“智能协同网络”

未来的无人系统不会孤立存在,它们将被纳入一个覆盖城市、乡村、边海疆的“空地感知与决策网络”中:

-

从飞行平台到地面控制,再到云端计算 → 需要视频数据的实时通达;

-

从视频到 AI 推理,再到系统反馈 → 需要数据的精准同步与可控性;

-

从人控系统到智能体协同 → 需要感知链路的标准化、平台化、组件化。

✅ 视频,将从“信息展示”跃升为“系统控制链条的一部分”;

✅ 而大牛直播SDK,将成为这一控制链条中的关键环节——视觉信号的标准入口。

✅ 结语一句话:

让每一帧都可控,每一图都可解,每一端都可联,才能真正构建智能化的低空系统。

而大牛直播SDK,正是在这个体系中,让视频不止于看,更用于“协同、理解与执行”。

📎 CSDN官方博客:音视频牛哥-CSDN博客

)

)

:设计思路与实现原理(C/C++代码实现))

條件指令、循環結構、定義函數)