从计算机视觉转行搜广推的第9天

1.youtubednn

推荐系统经典模型YouTubeDNN_推荐系统架构图-CSDN博客文章浏览阅读2.1k次,点赞28次,收藏34次。本文详细介绍了YouTubeDNN推荐系统,包括其召回阶段的多模型筛选策略,排序阶段的复杂模型以及关键的负采样、特征构造和上下文选择技巧。文章强调了YouTubeDNN如何解决大数据量下的推荐问题和模型效率优化。https://blog.csdn.net/sinat_31854967/article/details/136252252?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522f5de33b05f7634fdf9bc31fb85612067%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=f5de33b05f7634fdf9bc31fb85612067&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_positive~default-1-136252252-null-null.142^v102^pc_search_result_base8&utm_term=youtubeDNN&spm=1018.2226.3001.41872.快速排序,我还是习惯用C++来写

def quick_sort(arr):if len(arr) <= 1:return arr # 递归出口pivot = arr[0] # 选取基准值(可以随机,也可以选中间值)left = [x for x in arr[1:] if x <= pivot] # 小于等于 pivot 的元素right = [x for x in arr[1:] if x > pivot] # 大于 pivot 的元素return quick_sort(left) + [pivot] + quick_sort(right)

3.拍卖机制需要满足激励兼容

激励兼容是指:在一个机制中,每个参与者的最佳策略就是如实报告自己的真实信息(如物品的估值),即使他们知道其他人的策略或规则。

避免作弊行为,保证机制的可执行性

确保资源高效配置

4.解决跷跷板问题,下面的链接介绍了多个网络,mmoe,cgc,pil,esmm

推荐系统中的多目标建模与优化-CSDN博客文章浏览阅读3.1k次,点赞2次,收藏7次。多目标建模已经成为当前推荐系统中的标配,在多目标建模过程中,需要考虑多个目标之间的相互关系,以选择合适的多目标建模方法,同时,在多目标的损失函数的设计上,也存在很多的优化方案,需要根据具体的应用场景选择合适的损失函数,以达到对具体任务的优化。_多目标建模https://blog.csdn.net/google19890102/article/details/1286579425.除了 AUC,还有哪些常用的排序评估指标?

Hit Rate / Recall@k,GAUC(Grouped AUC)

6.评估 CTR 校准模块的效果?

校准准确性

业务指标的变化

7.决策树【机器学习】决策树(理论)-CSDN博客文章浏览阅读5.1w次,点赞396次,收藏1.9k次。本文详细介绍了决策树的构建原理,包括熵的作用、信息增益、条件熵、信息增益率和基尼系数等关键概念,以及在实际应用中如何选择最优特征。此外,还讨论了决策树的预剪枝处理,如限制树的深度、叶子结点个数和信息增益,以防止过拟合。https://blog.csdn.net/the_ZED/article/details/129290733?ops_request_misc=%257B%2522request%255Fid%2522%253A%25227ba206c72379c8540cd4b4468b733f88%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=7ba206c72379c8540cd4b4468b733f88&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_positive~default-1-129290733-null-null.142^v102^pc_search_result_base8&utm_term=%E5%86%B3%E7%AD%96%E6%A0%91&spm=1018.2226.3001.41878.

从 KL 散度角度:交叉熵可看作是 KL 散度的一部分,它衡量两个分布之间的差异

最大似然估计角度:交叉熵也可以从最大似然的角度解释,通过最小化交叉熵损失,模型可以最大化真实标签的概率。

AUC(Area Under Curve):ROC 曲线下面积,衡量模型在不同阈值下的分类性能。AUC 越高,模型的区分能力越强。

解决的问题:在不平衡数据集上,AUC 提供了一个综合指标来评估模型的性能,而不仅依赖于准确率。

优点:

对不平衡数据较为稳健。

衡量模型在不同阈值下的表现,不依赖单一阈值。

缺点:

不适合处理类别极其不平衡的数据。

有时难以解释其实际意义,尤其是当 AUC 相似时

9. Adam优化器的优势

自适应学习率:Adam通过计算每个参数的一阶矩(均值)和二阶矩(方差)来动态调整学习 率,避免了手动调整学习率的复杂性

SGD优化器的优势

SGD的超参数较少,调参相对简单,计算量较小,内存占用少

Adam在某些情况下更容易发散,而SGD的发散风险较低,但需要仔细调整学习率

10.attention机制的优势和劣势分别在哪里?

优点:Attention 机制能够同时捕捉全局和局部信息,避免了 RNN 对长期依赖的捕捉受序列长度限制的问题,与 RNN 不同,Attention 的每一步计算不依赖于上一步的结果,因此可以并行处理

缺点:Attention 机制本身无法直接捕捉序列中的位置信息,需要通过额外的手段(如位置编码)来补充,处理长序列时,Attention 的计算复杂度会显著增加,Attention 机制的效果依赖于大量数据,如果数据量不足,可能无法充分发挥其优势

11

Transformer为什么Q和K使用不同的权重矩阵生成,为何不能使用同一个值进行自身的点乘?

在Transformer中,Q(查询)和K(键)使用不同的权重矩阵生成是为了打破对称性,使得模型能够学习到更复杂的关系。具体来说,Q和K的点积计算相似度时,使用不同的权重矩阵可以使得模型在计算注意力时考虑到不同的上下文信息。

为什么在进行多头注意力的时候需要对每个head进行降维?

在多头注意力机制中,对每个头进行降维的主要原因是为了降低计算复杂度,同时保持模型的表达能力。通过将输入特征分成多个低维子空间,模型能够在每个子空间中独立学习特征,从而提高学习效率。

为何在获取输入词向量之后需要对矩阵乘以embedding size的开方?意义是什么?

在获取输入词向量后乘以embedding size的开方,主要是为了确保词向量的方差适中,从而提高模型的训练稳定性。通过这种方式,可以避免在训练过程中出现梯度消失或爆炸的问题。

简单介绍一下Transformer的位置编码?有什么意义和优缺点?

位置编码是Transformer中用于引入序列位置信息的技术。由于Transformer模型并不具备处理序列顺序的能力,因此需要通过位置编码将位置信息嵌入到输入的词向量中。

位置编码通常使用正弦和余弦函数生成,能够有效地表示单词在序列中的位置。其优点在于可以处理任意长度的序列,同时保持相对位置关系。

你还了解哪些关于位置编码的技术,各自的优缺点是什么?

除了传统的正弦余弦位置编码,还有其他几种位置编码技术:

学习型位置编码:通过训练学习每个位置的编码,优点是灵活性高,但缺点是需要额外的参数和训练时间。

相对位置编码:通过相对位置关系来编码,能够更好地捕捉上下文信息,缺点是实现复杂度较高。

Decoder阶段的多头自注意力和encoder的多头自注意力有什么区别?

Decoder阶段的多头自注意力与Encoder的多头自注意力的主要区别在于Decoder需要进行序列mask操作。这是因为在解码时,模型只能看到之前的位置,而不能访问未来的信息。

序列mask确保了Decoder在计算自注意力时不会考虑未来的信息,从而避免了信息泄露。

Transformer 中的 attention mask 是 结构性硬规则

用于:

-

防止信息“越界”,例如:

-

Decoder 的自回归生成中,只允许看到前面的 token,不能看后面的。

-

Padding mask:避免把填充符号纳入计算。

-

特点:

-

完全是手工指定的规则性屏蔽(hard masking);

-

是attention score 层的逻辑操作,不是训练目标;

-

它不参与 loss 的反向传播学习,而是直接控制 attention 能否发生。

✅ 2. BERT 的 MLM mask 是一种训练目标上的随机扰动

作用:

-

训练时随机选择输入中的 15% 位置做掩码,然后让模型预测这些被“挖空”的 token;

-

是一种 自监督目标(self-supervised objective),相当于人为制造“填空题”让模型学会语言建模。

特点:

-

掩码位置是 随机选的(静态的),不是从模型学习来的;

-

掩码本身是损失函数的组成部分,是训练目标;

-

它作用在输入 embedding 层,而不是 attention score 层。

12.贝叶斯估计:

将参数θ视为随机变量,并假设其服从某个先验分布P(θ)。通过贝叶斯定理计算后验分布,输出参数的后验分布P(θ∣D),预测时对所有可能的θ加权平均

13.

经典机器学习模型(八)梯度提升树GBDT详解-CSDN博客文章浏览阅读9.8k次,点赞31次,收藏63次。经典机器学习模型(八)梯度提升树GBDT详解_gbdthttps://blog.csdn.net/qq_44665283/article/details/137559749?ops_request_misc=%257B%2522request%255Fid%2522%253A%25220189776b0c7ea3c37de9bbd709e0b3f9%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=0189776b0c7ea3c37de9bbd709e0b3f9&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_click~default-2-137559749-null-null.142^v102^pc_search_result_base8&utm_term=GBDT&spm=1018.2226.3001.4187

详解 CatBoost 原理-CSDN博客文章浏览阅读1.7w次,点赞36次,收藏129次。详解 CatBoost 原理集成学习的两大准则:基学习器的准确性和多样性。算法:串行的Boosting和并行的Bagging,前者通过错判训练样本重新赋权来重复训练,来提高基学习器的准确性,降低偏差!后者通过采样方法,训练出多样性的基学习器,降低方差。1.catboost 的优缺点性能卓越:在性能方面可以匹敌任何先进的机器学习算法鲁棒性/强健性:它减少了对很多超参数调优的需求,并降低了过度拟合的机会,这也使得模型变得更加具有通用性易于使用:提供与 scikit 集成的 Python 接口,以及_catboosthttps://blog.csdn.net/weixin_49708196/article/details/124018649机器学习—LightGBM的原理、优化以及优缺点_lightgbm优缺点-CSDN博客文章浏览阅读2.4w次,点赞78次,收藏225次。LightGBM是为解决GBDT在海量数据中的效率问题而提出的,通过直方图算法、单边梯度采样、互斥特征捆绑和带深度限制的Leaf-wise算法实现速度和内存的优化。与XGBoost相比,LightGBM在内存占用和计算速度上具有显著优势,同时支持类别特征,并行计算和缓存优化。然而,Leaf-wise策略可能导致过拟合,需要设置最大深度限制。

https://blog.csdn.net/weixin_46649052/article/details/119604545【机器学习】XGBoost数学原理及详细实现过程_xgboost的数学原理-CSDN博客文章浏览阅读3.9k次,点赞6次,收藏42次。XGBoost(Extreme Gradient Boosting)是一种高效的梯度提升决策树算法,与lightgbm是目前表格型数据竞赛最主流的树模型。它在原有的GBDT(Gradient Boosting Decision Tree)基础上进行了改进,使得模型效果得到大大提升。XGBoost是由多棵CART(Classification And Regression Tree)组成,因此它不仅可以处理分类回归等问题。_xgboost的数学原理

https://blog.csdn.net/qq_70699891/article/details/134257083

XGBoost 优缺点

3.1 优点

精度更高: GBDT 只用到一阶泰勒展开,而 XGBoost 对损失函数进行了二阶泰勒展开。XGBoost 引入二阶导一方面是为了增加精度,另一方面也是为了能够自定义损失函数,二阶泰勒展开可以近似大量损失函数;

灵活性更强: GBDT 以 CART 作为基分类器,XGBoost 不仅支持 CART 还支持线性分类器,使用线性分类器的 XGBoost 相当于带 L1和 L2正则化项的逻辑斯蒂回归(分类问题)或者线性回归(回归问题)。此外,XGBoost 工具支持自定义损失函数,只需函数支持一阶和二阶求导;

正则化: XGBoost 在目标函数中加入了正则项,用于控制模型的复杂度。正则项里包含了树的叶子节点个数、叶子节点权重的 范式。正则项降低了模型的方差,使学习出来的模型更加简单,有助于防止过拟合,这也是XGBoost优于传统GBDT的一个特性。

Shrinkage(缩减): 相当于学习速率。XGBoost 在进行完一次迭代后,会将叶子节点的权重乘上该系数,主要是为了削弱每棵树的影响,让后面有更大的学习空间。传统GBDT的实现也有学习速率;

列抽样: XGBoost 借鉴了随机森林的做法,支持列抽样,不仅能降低过拟合,还能减少计算。这也是XGBoost异于传统GBDT的一个特性;

缺失值处理: 对于特征的值有缺失的样本,XGBoost 采用的稀疏感知算法可以自动学习出它的分裂方向;

XGBoost工具支持并行: boosting不是一种串行的结构吗?怎么并行的?注意XGBoost的并行不是tree粒度的并行,XGBoost也是一次迭代完才能进行下一次迭代的(第 t 次迭代的代价函数里包含了前面 t-1 次迭代的预测值)。XGBoost的并行是在特征粒度上的。我们知道,决策树的学习最耗时的一个步骤就是对特征的值进行排序(因为要确定最佳分割点),XGBoost在训练之前,预先对数据进行了排序,然后保存为block结构,后面的迭代中重复地使用这个结构,大大减小计算量。这个block结构也使得并行成为了可能,在进行节点的分裂时,需要计算每个特征的增益,最终选增益最大的那个特征去做分裂,那么各个特征的增益计算就可以开多线程进行。

可并行的近似算法: 树节点在进行分裂时,我们需要计算每个特征的每个分割点对应的增益,即用贪心法枚举所有可能的分割点。当数据无法一次载入内存或者在分布式情况下,贪心算法效率就会变得很低,所以XGBoost还提出了一种可并行的近似算法,用于高效地生成候选的分割点。

3.1 缺点

虽然利用预排序和近似算法可以降低寻找最佳分裂点的计算量,但在节点分裂过程中仍需要遍历数据集;

预排序过程的空间复杂度过高,不仅需要存储特征值,还需要存储特征对应样本的梯度统计值的索引,相当于消耗了两倍的内存。

XGBoost与GBDT的联系和区别有哪些?

(1)GBDT是机器学习算法,XGBoost是该算法的工程实现。

(2)正则项: 在使用CART作为基分类器时,XGBoost显式地加入了正则项来控制模型的复杂度,有利于防止过拟合,从而提高模型的泛化能力。

(3)导数信息: GBDT在模型训练时只使用了代价函数的一阶导数信息,XGBoost对代价函数进行二阶泰勒展开,可以同时使用一阶和二阶导数。

(4)基分类器: 传统的GBDT采用CART作为基分类器,XGBoost支持多种类型的基分类器,比如线性分类器。

(5)子采样: 传统的GBDT在每轮迭代时使用全部的数据,XGBoost则采用了与随机森林相似的策略,支持对数据进行采样。

(6)缺失值处理: 传统GBDT没有设计对缺失值进行处理,XGBoost能够自动学习出缺失值的处理策略。

(7)并行化: 传统GBDT没有进行并行化设计,注意不是tree维度的并行,而是特征维度的并行。XGBoost预先将每个特征按特征值排好序,存储为块结构,分裂结点时可以采用多线程并行查找每个特征的最佳分割点,极大提升训练速度。

6.2 为什么XGBoost泰勒二阶展开后效果就比较好呢?

(1)从为什么会想到引入泰勒二阶的角度来说(可扩展性): XGBoost官网上有说,当目标函数是MSE时,展开是一阶项(残差)+二阶项的形式,而其它目标函数,如logistic loss的展开式就没有这样的形式。为了能有个统一的形式,所以采用泰勒展开来得到二阶项,这样就能把MSE推导的那套直接复用到其它自定义损失函数上。简短来说,就是为了统一损失函数求导的形式以支持自定义损失函数。至于为什么要在形式上与MSE统一?是因为MSE是最普遍且常用的损失函数,而且求导最容易,求导后的形式也十分简单。所以理论上只要损失函数形式与MSE统一了,那就只用推导MSE就好了。

(2)从二阶导本身的性质,也就是从为什么要用泰勒二阶展开的角度来说(精准性): 二阶信息本身就能让梯度收敛更快更准确。这一点在优化算法里的牛顿法中已经证实。可以简单认为一阶导指引梯度方向,二阶导指引梯度方向如何变化。简单来说,相对于GBDT的一阶泰勒展开,XGBoost采用二阶泰勒展开,可以更为精准的逼近真实的损失函数。

6.3 XGBoost对缺失值是怎么处理的?

在普通的GBDT策略中,对于缺失值的方法是先手动对缺失值进行填充,然后当做有值的特征进行处理,但是这样人工填充不一定准确,而且没有什么理论依据。而XGBoost采取的策略是先不处理那些值缺失的样本,采用那些有值的样本搞出分裂点,在遍历每个有值特征的时候,尝试将缺失样本划入左子树和右子树,选择使损失最优的值作为分裂点。

6.4 XGBoost为什么可以并行训练?

(1)XGBoost的并行,并不是说每棵树可以并行训练,XGBoost本质上仍然采用boosting思想,每棵树训练前需要等前面的树训练完成才能开始训练。

(2)XGBoost的并行,指的是特征维度的并行:在训练之前,每个特征按特征值对样本进行预排序,并存储为Block结构,在后面查找特征分割点时可以重复使用,而且特征已经被存储为一个个block结构,那么在寻找每个特征的最佳分割点时,可以利用多线程对每个block并行计算。

LightGBM的优缺点

这部分主要总结下 LightGBM 相对于 XGBoost 的优点,从内存和速度两方面进行介绍。

(1)速度更快

-

LightGBM 采用了直方图算法将遍历样本转变为遍历直方图,极大的降低了时间复杂度;

-

LightGBM 在训练过程中采用单边梯度算法过滤掉梯度小的样本,减少了大量的计算;

-

LightGBM 采用了基于 Leaf-wise 算法的增长策略构建树,减少了很多不必要的计算量;

-

LightGBM 采用优化后的特征并行、数据并行方法加速计算,当数据量非常大的时候还可以采用投票并行的策略;

-

LightGBM 对缓存也进行了优化,增加了缓存命中率;

(2)内存更小

-

XGBoost使用预排序后需要记录特征值及其对应样本的统计值的索引,而 LightGBM 使用了直方图算法将特征值转变为 bin

值,且不需要记录特征到样本的索引,将空间复杂度从 O ( 2 ∗ # d a t a ) O(2*\#data)O(2∗#data)

降低为O ( # b i n ) O(\#bin)O(#bin),极大的减少了内存消耗; -

LightGBM 采用了直方图算法将存储特征值转变为存储 bin 值,降低了内存消耗;

-

LightGBM 在训练过程中采用互斥特征捆绑算法减少了特征数量,降低了内存消耗。

-

可能会长出比较深的决策树,产生过拟合。因此LightGBM在Leaf-wise之上增加了一个最大深度限制,在保证高效率的同时防止过拟合;

-

Boosting族是迭代算法,每一次迭代都根据上一次迭代的预测结果对样本进行权重调整,所以随着迭代不断进行,误差会越来越小,模型的偏差(bias)会不断降低。由于LightGBM是基于偏差的算法,所以会对噪点较为敏感;

-

在寻找最优解时,依据的是最优切分变量,没有将最优解是全部特征的综合这一理念考虑进去;

catboost 的优缺点

性能卓越:在性能方面可以匹敌任何先进的机器学习算法

鲁棒性/强健性:它减少了对很多超参数调优的需求,并降低了过度拟合的机会,这也使得模型变得更加具有通用性

易于使用:提供与 scikit 集成的 Python 接口,以及 R 和命令行界面

实用:可以处理类别型、数值型特征

可扩展:支持自定义损失函数

支持类别型变量,无需对非数值型特征进行预处理

快速、可扩展的GPU版本,可以用基于GPU的梯度提升算法实现来训练你的模型,支持多卡并行

快速预测,即便应对延时非常苛刻的任务也能够快速高效部署模型

catboost 缺点

- 对于类别型特征的处理需要大量的内存和时间;

- 不同随机数的设定对于模型预测结果有一定的影响;

14.

15推荐系统中的偏置问题-bias和debias-CSDN博客文章浏览阅读1.5k次,点赞25次,收藏20次。推荐系统中存在很多偏差,如选择偏差、位置偏差、曝光偏差和流行度偏差等https://blog.csdn.net/jzwei023/article/details/135219069关联规则(Apriori、FP-grpwth)-CSDN博客文章浏览阅读1.1w次,点赞11次,收藏100次。什么是关联规则 关联规则(AssociationRules)是反映一个事物与其他事物之间的相互依存性和关联性,是数据挖掘的一个重要技术,用于从大量数据中挖掘出有价值的数据项之间的相关关系。 所谓数据挖掘就是以某种方式分析源数据,从中发现一些潜在的有用的信息 。即数据挖掘又可以称作知识发现,而机器学习算法则是这种“某种方式”。 举..._关联规则

https://blog.csdn.net/one_super_dreamer/article/details/102803355?ops_request_misc=&request_id=&biz_id=102&utm_term=%E5%85%B3%E8%81%94%E8%A7%84%E5%88%99&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-0-102803355.142^v102^pc_search_result_base8&spm=1018.2226.3001.4187图像检索 - 乘积量化PQ(Product Quantization)_pq量化-CSDN博客文章浏览阅读1.8w次,点赞10次,收藏33次。参考以下文章: 乘积量化(Product Quantization)最近邻搜索之乘积量化(Product Quantizer)理解(一)看了两天的乘积量化,先说下我自己的理解吧:(以下蓝字使我的理解,红字是我看别人的博客暂时没弄懂的,我写的比较啰嗦以便我回头自己翻看时不会再有疑问(#^.^#)) 假设我们的图片检索库有100万张图片,每张图片提取多个128维的特征向量,..._pq量化

https://blog.csdn.net/guanyonglai/article/details/78468673?ops_request_misc=%257B%2522request%255Fid%2522%253A%25222510278dcb7b9f936e7ad117d56b9ccc%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fall.%2522%257D&request_id=2510278dcb7b9f936e7ad117d56b9ccc&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~first_rank_ecpm_v1~rank_v31_ecpm-2-78468673-null-null.142^v102^pc_search_result_base8&utm_term=Product%20quantization%E4%B9%98%E7%A7%AF%E9%87%8F%E5%8C%96&spm=1018.2226.3001.418716.LSTM

https://blog.csdn.net/v_JULY_v/article/details/89894058?ops_request_misc=%257B%2522request%255Fid%2522%253A%25223af27334abf9805fe68342d5717108ca%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=3af27334abf9805fe68342d5717108ca&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_positive~default-1-89894058-null-null.142^v102^pc_search_result_base8&utm_term=LSTM&spm=1018.2226.3001.4187![]() https://blog.csdn.net/v_JULY_v/article/details/89894058?ops_request_misc=%257B%2522request%255Fid%2522%253A%25223af27334abf9805fe68342d5717108ca%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=3af27334abf9805fe68342d5717108ca&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_positive~default-1-89894058-null-null.142^v102^pc_search_result_base8&utm_term=LSTM&spm=1018.2226.3001.4187

https://blog.csdn.net/v_JULY_v/article/details/89894058?ops_request_misc=%257B%2522request%255Fid%2522%253A%25223af27334abf9805fe68342d5717108ca%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=3af27334abf9805fe68342d5717108ca&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~top_positive~default-1-89894058-null-null.142^v102^pc_search_result_base8&utm_term=LSTM&spm=1018.2226.3001.4187

为什么 LSTM 比 RNN 好?

-

✅ 记忆机制:引入 Cell State,可长距离传递信息;

-

✅ 门控结构:遗忘门、输入门、输出门分别控制信息流,有效缓解梯度消失;

-

✅ 可控性强:每一步都能“决定”保留什么信息,丢弃什么,类比人脑的记忆调节;

-

✅ 泛化能力强:对变长输入、长距离依赖任务表现优越。

为什么要混合使用 sigmoid 和 tanh?

1. Sigmoid:门控控制,像开关一样工作

-

输出值范围是 (0,1)(0, 1)(0,1),易于解释为“保留多少比例的信息”。

-

典型用途:遗忘门、输入门、输出门

-

0 → 完全关闭(不保留/不更新/不输出)

-

1 → 完全打开(完全保留/更新/输出)

-

🎯 作用:用于控制信息流是否通过

2. Tanh:用于生成/处理信息本身

-

输出值范围是 (−1,1)(-1, 1)(−1,1),包含正负方向信息。

-

更适合表示真实的“信息内容”或“候选状态”。

-

正值:正向激活

-

负值:负向抑制

-

🎯 作用:用于建模信息值、记忆状态本身

三、如果统一使用 sigmoid 或 tanh,会有什么问题?

❌ 全用 sigmoid 会导致:

-

候选值只能是 (0,1)(0, 1)(0,1),不具备正负性。

-

无法表达“反向信息”(如负情绪、抑制信号)。

-

信息受限在一个方向,降低表示能力。

❌ 全用 tanh 会导致:

-

门控无法精确控制信息通断,因为 tanh∈(−1,1)\tanh \in (-1,1)tanh∈(−1,1),门开关不明显。

-

“门”失去明确的保留/遗忘语义。

17.推导LR和SVM,写纸上

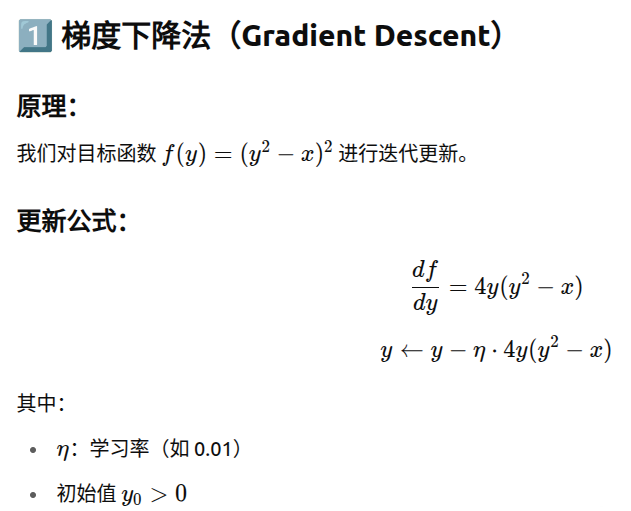

18.梯度下降法中,为什么在负梯度方向函数值下降最快?

19.

FM模型-CSDN博客文章浏览阅读9.8k次,点赞10次,收藏30次。FM模型,即因子分解机,是一种用于解决高维稀疏数据问题的机器学习模型。它通过引入交叉项特征和隐向量,提高了模型的预测能力。本文详细介绍了FM模型的工作原理,包括特征组合、求解过程及梯度计算,并提供了代码实现。https://blog.csdn.net/sysu63/article/details/102678572?ops_request_misc=&request_id=&biz_id=102&utm_term=FM%E6%A8%A1%E5%9E%8B&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-2-102678572.142^v102^pc_search_result_base8&spm=1018.2226.3001.4187FFM模型在CTR和CVR预估中的应用与实践-CSDN博客文章浏览阅读6.7k次,点赞4次,收藏16次。FM和FFM模型是最近几年提出的模型,凭借其在数据量比较大并且特征稀疏的情况下,仍然能够得到优秀的性能和效果的特性,屡次在各大公司举办的CTR预估比赛中获得不错的战绩。美团点评技术团队在搭建DSP的过程中,探索并使用了FM和FFM模型进行CTR和CVR预估,并且取得了不错的效果。本文旨在把我们对FM和FFM原理的探索和应用的经验介绍给有兴趣的读者。文章参考:【1】文章目录1. FFM模型原理2. FFM模型实现3. FFM模型应用1. FFM模型原理假设一个广告分类的问题,根据用户和广告位相关的._ffm模型

https://blog.csdn.net/weixin_44441131/article/details/119827464推荐系统 - DeepFM架构详解_deep fm-CSDN博客文章浏览阅读4w次,点赞43次,收藏231次。说明理论部分请参照:https://www.jianshu.com/p/6f1c2643d31b,这里主要针对源码进行解读,填一些坑。简单介绍1.DeepFM可以看做是从FM基础上衍生的算法,将Deep与FM相结合,用FM做特征间低阶组合,用Deep NN部分做特征间高阶组合,通过并行的方式组合两种方法,使得最终的架构具有以下特点。 (1) 不需要预训练 FM 得到隐向量;..._deep fm

https://blog.csdn.net/maqunfi/article/details/99635620?ops_request_misc=&request_id=&biz_id=102&utm_term=deepFM%E6%A8%A1%E5%9E%8B&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-3-99635620.142^v102^pc_search_result_base8&spm=1018.2226.3001.4187

推荐系统遇上深度学习(二十二):DeepFM升级版XDeepFM模型强势来袭!-CSDN博客文章浏览阅读2.9k次,点赞3次,收藏11次。今天我们要学习的模型是xDeepFM模型,论文地址为:https://arxiv.org/abs/1803.05170。文中包含我个人的一些理解,如有不对的地方,欢迎大家指正!废话不多说,我们进入正题!1、引言对于预测性的系统来说,特征工程起到了至关重要的作用。特征工程中,挖掘交叉特征是至关重要的。交叉特征指的是两个或多个原始特征之间的交叉组合。例如,在新闻推荐场景中,一个三阶交叉特征为A..._xdeepfmhttps://blog.csdn.net/hellozhxy/article/details/82981077?ops_request_misc=%257B%2522request%255Fid%2522%253A%252220176e12f89bb19e7df6e08df1e36fb6%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=20176e12f89bb19e7df6e08df1e36fb6&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-2-82981077-null-null.142^v102^pc_search_result_base8&utm_term=xDeepFM&spm=1018.2226.3001.4187

20.判别模型和生成模型是两个相对应的模型。

判别模型是直接生成一个表示或者的判别函数(或预测模型)

生成模型是先计算联合概率分布然后通过贝叶斯公式转化为条件概率。

21.朴素贝叶斯公式

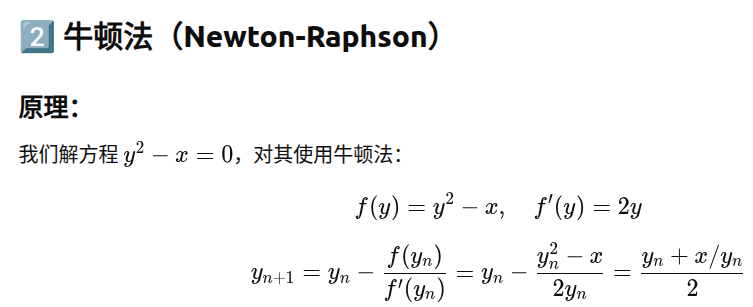

22.手写sqrt函数

def sqrt(n):if n < 0:raise ValueError("只能处理非负整数")if n == 0 or n == 1:return nleft, right = 1, n // 2ans = 1while left <= right:mid = (left + right) // 2if mid * mid == n:return midelif mid * mid < n:ans = mid # 记录当前最接近的平方根left = mid + 1else:right = mid - 1return ans

23.

-

模型batch内负采样怎么做的?

-

加bias有什么用?

答:负采样的本质是想打压高曝光item,但是由于高曝光的item本身就频繁出现在样本中,随机采可能会打压过头,因此加一个bias tower进行修正(其实就是学一个值取平衡正负样本)。

24.在Adam当中,weight decay是直接加入到梯度当中,AdamW直接在权重上进行衰减,在收敛速度上也能领先于Adam。

25.TPE算法的核心思想是使用两个不同的概率密度函数来建模参数的条件概率分布:一个用于建模表现好的参数配置的概率密度函数(Exploitation),另一个用于建模未知的参数配置的概率密度函数(Exploration)。通过不断地调整这两个概率密度函数,TPE算法能够有针对性地在参数空间中搜索,从而更可能找到全局最优解。

TPE算法的步骤如下:

初始化: 随机生成一组初始参数配置,并评估它们的性能。

迭代: 在每一轮迭代中,根据已经观察到的参数配置和它们的性能,使用Exploitation模型和Exploration模型分别生成候选参数配置。

Exploitation模型: 该模型基于已知性能好的参数配置,通过建模条件概率分布,产生一个新的参数配置,以期望获得更好的性能。

Exploration模型: 该模型用于在未知区域进行搜索,通过建模条件概率分布,产生一个新的参数配置,以期望发现未知但可能性能更好的区域。

评估: 对生成的候选参数配置进行评估,得到它们的性能。

更新模型: 根据评估结果,更新Exploitation和Exploration模型。

重复迭代: 重复进行迭代,直到达到预定的迭代次数或满足停止条件。

26.XGBoost 中分箱一般使用的是:

✅ 等频分箱(等深分箱,quantile binning)

把数据划分成数量相等的 bin,每个 bin 中包含的样本数尽可能相等。

27.推荐系统:冷启动问题【用户冷启动、物品冷启动、系统冷启动】_解决用户冷启动推荐算法-CSDN博客文章浏览阅读1w次,点赞16次,收藏59次。推荐系统的主要目标是将大量的标的物推荐给可能喜欢的海量用户,这里涉及到标的物和用户两类对象。任何互联网推荐产品,标的物和用户都是不断增长变化的,所以一定会频繁面对新标的物和新用户,推荐系统冷启动问题指的就是对于新注册的用户或者新入库的标的物,该怎么给新用户推荐标的物让用户满意,怎么将新标的物分发出去,推荐给喜欢它的用户。推荐系统系列(10)推荐系统冷启动。........._解决用户冷启动推荐算法https://blog.csdn.net/u013250861/article/details/126075335?ops_request_misc=%257B%2522request%255Fid%2522%253A%25224f35c7a621ed8220d19187db0eebda96%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=4f35c7a621ed8220d19187db0eebda96&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~baidu_landing_v2~default-4-126075335-null-null.142^v102^pc_search_result_base8&utm_term=%E5%A6%82%E4%BD%95%E8%A7%A3%E5%86%B3%E6%8E%A8%E8%8D%90%E7%B3%BB%E7%BB%9F%E4%B8%AD%E7%9A%84%E5%86%B7%E5%90%AF%E5%8A%A8%E9%97%AE%E9%A2%98%EF%BC%9F&spm=1018.2226.3001.4187

28.SSB(Sample Selection Bias,样本选择偏差)指的是:训练数据的分布与测试/实际应用环境的数据分布不一致,从而导致模型训练得到的规律在部署时效果变差。

这是机器学习,尤其是推荐系统和广告排序系统中常见且严重的问题。

29.transformer计算复杂度

(yakit方式))

)