Stable Diffusion Windows 本地部署超详细教程 (手动 + 自动 + 整合包三种方式)

一、引言

我们可以通过官方网站 Stability AI,以及 Dream Studio、Replicate、Playground AI 、Baseten 等网站在线体验 Stable Diffusion 的巨大威力。相比于集成在网络平台的 SD 或者其他 AI 绘画平台来说,自部署平台没有生成数量的限制,不用花钱,不用被 NSFW 约束,生成时间快,不用排队,自由度高,而且功能完整,插件丰富,可以调试和个性化的地方也更多;更稳定,也更容易让 SD 变成生产力或者商业化使用。既然这样,那就自力更生,在本机上自己部署一个,可以随心所欲地玩图。

二、Stable Diffusion 安装

2.1 安装前的准备

现有深度学习训练和部署环境在硬件上一般基于 Nvidia GPU,在底层需要显卡驱动和 CUDA 工具包(需要包含配套版本的 cuDNN),在应用软件层面需要 Python 编译和解释器,以及基于 Python 的深度学习框架(如 Pytorch、TensorFlow 等)。同时,为了方便代码自动下载和程序模块化管理,通常还需要安装 git 和 conda 软件。笔者(Sheex2012)主机配备了 RTX 4070Ti 12G 显卡,并事先安装了 CUDA 12.1,Python 3.11.6,git 2.44,Pytorch 2.1.2,能够满足 Stable Diffusion 环境要求。本文重点聚焦 Stable Diffusion 推理程序的部署,硬件需求确认和基础软件的安装这里不再赘述。

2.2 下载和部署 Stable Diffusion

我们从 Stability.AI 的 github 官方开源 Stability.AI Stablediffusion 下载源码:

git clone https://github.com/Stability-AI/stablediffusion.git

当然,也可以从网页上以下载源码 ZIP 包,解压缩到本地。

源码下载完成后,接下来需要安装项目的依赖项:

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

然后从 huggingface 下载预训练模型 v2-1_768-ema-pruned.ckpt,并存放到 checkpoints 文件夹中。

2.3 运行 Stable Diffusion

部署完成后,运行下述脚本,生成图片:

python ./scripts/txt2img.py --prompt "a professional photograph of an astronaut riding a horse" --ckpt ./checkpoints/v2-1\_768-ema-pruned.ckpt --config ./configs/stable-diffusion/v2-inference-v.yaml --H 768 --W 768

这个应该是目录结构的问题,将 ldm 拷贝 / 移动到 script 文件夹,再来一次,不出意外,还是有点小意外,内存不够了:

torch.cuda.OutOfMemoryError: CUDA out of memory. Tried to allocate 9.49 GiB. GPU 0 has a total capacty of 11.99 GiB of which 0 bytes is free. Of the allocated memory 14.77 GiB is allocated by PyTorch, and 9.52 GiB is reserved by PyTorch but unallocated. If reserved but unallocated memory is large try setting max\_split\_size\_mb to avoid fragmentation. See documentation for Memory Management and PYTORCH\_CUDA\_ALLOC\_CONF

那就把图像的尺寸调整成 512x512,问题解决了。

这是生成的图片(存放在 outputs\txt2img-samples 文件夹中):

三、Stable Diffusion WebUI 安装

Stable Diffusion 只是提供一个模型,提供基础的文本分析、特征提取、图片生成这些核心功能,但自身是没有可视化 UI 的,用起来就是各种文件加命令行。其中流传最广、功能最强也是被公认最为方便的,就是由越南超人 AUTOMATIC1111 开发的 WebUI,即大名鼎鼎的 Stable Diffusion WebUI。Stable Diffusion WebUI 集成了大量代码层面的繁琐应用,将 Stable Diffusion 的各项绘图参数转化成可视化的选项数值和操控按钮,用户可以直接通过 Web 页面使用 Stable Diffusion。Stable Diffusion WebUI 是一个最流行的开源 Stable Diffusion 整合程序,其核心功能是文生图和图生图,这也是 Stable Diffusion 的核心能力。Stable Diffusion WebUI 的其它功能,比如 ControlNet、高清放大、模型训练等等都是其它第三方开发的,有的已经内置到 WebUI 中,随着 WebUI 的发布而发布,有的还需要用户手动安装。

3.1 手动安装

我们先手动方式一步一步安装,从中体验一下其中的繁琐(其实,这对于从事深度学习的相关技术人员来说是常规操作)。

首先,从 github 上下载源码:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

其次,下载安装 Stable Diffusion WebUI 的依赖项:

cd stable-diffusion-webuipip install -r requirements\_versions.txt -i https://pypi.tuna.tsinghua.edu.cn/simple pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

依赖项成功安装后,还是从 huggingface 下载 v1-5-pruned-emaonly.safetensors 预训练模型,放置到 models\Stable-diffusion 文件夹。

python webui.py

命令行窗口显示了模型加载运行过程,这里一共花了 49.2 秒。

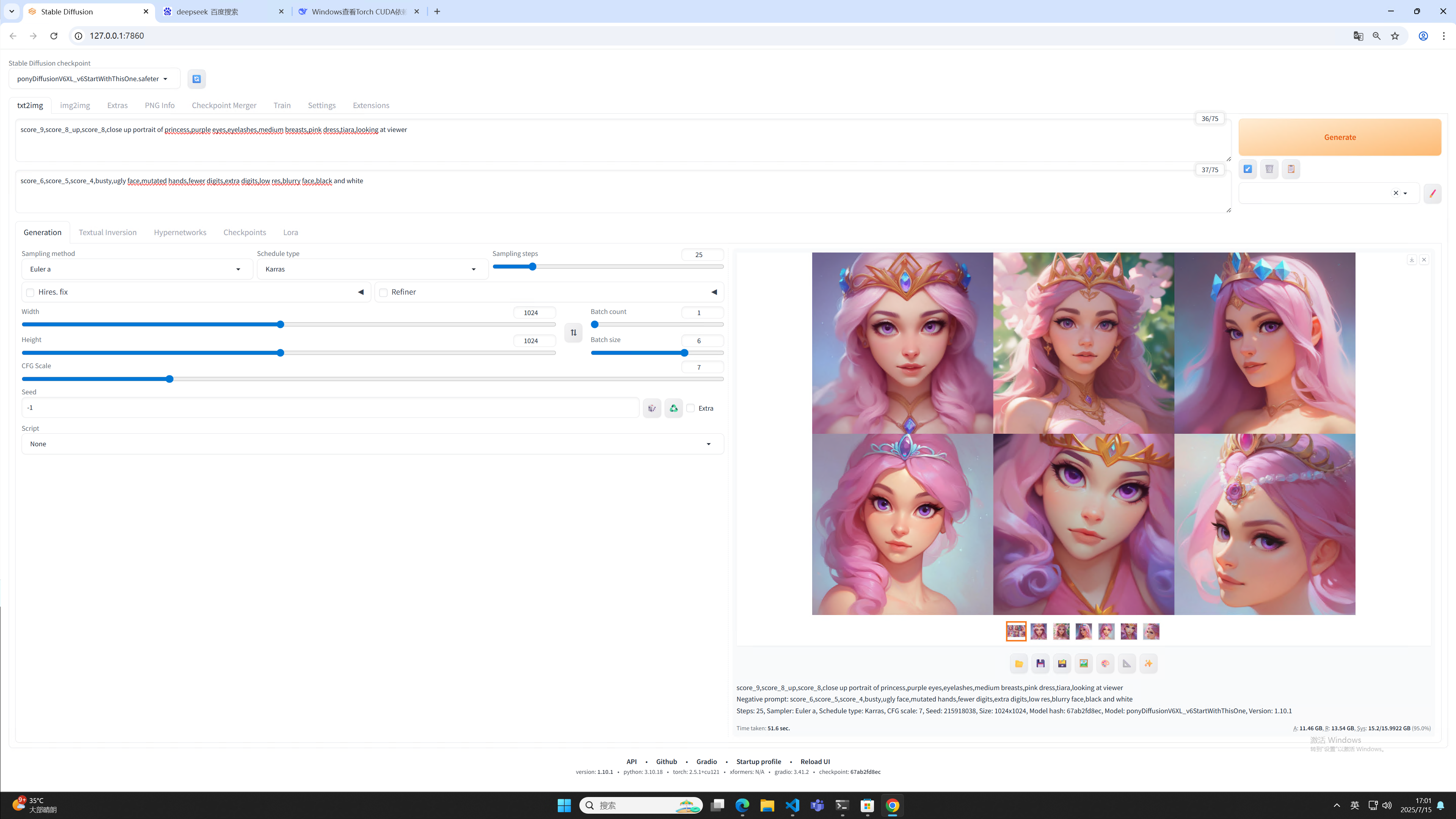

进入http://127.0.0.1:7860网站,输入提示词:

反向提示词:

点击,Generate 按钮,3.9 秒后,生成一幅女孩肖像画。GPU 占用 3.8G 左右。

如果觉得全是英文的界面操作起来不够方便,可以:

1)从 Stable-diffusion-webui 的汉化扩展下载汉化语言包,把 "l

3.2 自动安装

自动安装的方式,极大地简化了部署流程,对于不太熟悉命令行操作和复杂环境配置的新手来说,是非常友好的选择。这里以使用 “StableDiffusion-WebUI-Automatic-Installer” 脚本为例进行介绍。

首先,下载 “StableDiffusion-WebUI-Automatic-Installer” 脚本。你可以在相关的开源平台找到它,比如 github(链接:https://github.com/cmdr2/stable-diffusion-ui) 。下载完成后,解压到你希望安装 Stable Diffusion WebUI 的目录。

然后,进入解压后的目录,找到并双击运行 “webui-user.bat” 文件(如果是 Linux 或 Mac 系统,则运行对应的.sh 文件)。这个批处理文件会自动检测你的系统环境,安装所需的 Python 版本、依赖库,下载 Stable Diffusion WebUI 的源码以及预训练模型等。在这个过程中,命令行窗口会显示安装的进度和相关信息。由于下载的内容较多,可能需要一些时间,请耐心等待。安装过程中可能会因为网络问题导致某些下载失败,你可以尝试多次运行 “webui-user.bat” 文件,它会自动检测哪些部分未成功安装并进行重试。

安装完成后,同样会自动打开浏览器并跳转到http://127.0.0.1:7860页面,此时你就可以像手动安装成功后一样,在 WebUI 界面中输入提示词进行 AI 绘画创作了。

3.3 整合包安装

Stable Diffusion 秋叶整合包是中国大神秋叶基于 Stable Diffusion WebUI 内核开发的整合包,内置了与电脑本身系统隔离的 Python 环境和 Git(包含了第三部分需要下载和安装的依赖项、github 依赖包、预训练模型以及相当多的插件)。可以忽略网络需求和 Python 环境的门槛,让更多人轻松地使用 Stable Diffusion WebUI。超简单一键安装,无任何使用门槛,完全免费使用,支持 Nvdia 全系列显卡。

- 配置要求:

-

系统:Windows 10 及以上系统

-

显存最低 4G,建议使用 Nvidia 2060 显卡,显存 6GB 以上。内存至少是 8GB,而配备 16GB 或者以上内存,你会有更好的使用体验

-

下载文件:

下载到本地,最好不要有中文目录,整合包地址链接:链接:下载到本地,最好不要有中文目录,整合包地址链接:链接:https://pan.baidu.com/s/11e-upzehUb_qH5iuqVIBfg?

-

解压文件夹到本地,点击启动器

-

点击一键启动

可以看到出现了命令行,稍等等几秒钟,会自动跳到 Web UI 页面。然后就可以在文本框中,输入指令来进行 AI 生图了。

四、总结

通过以上手动、自动和整合包三种方式,我们都能够在 Windows 系统上成功部署 Stable Diffusion WebUI。手动安装虽然步骤较为繁琐,但能让我们深入了解整个部署过程和相关技术细节,适合有一定技术基础和希望深入掌握的用户;自动安装借助脚本大大简化了流程,降低了部署难度,适合大部分普通用户;整合包安装则几乎做到了开箱即用,是最为便捷的方式,尤其适合对技术不太熟悉,只希望快速使用 Stable Diffusion 进行创作的用户。你可以根据自己的情况和需求选择适合的安装方式,开启你的 AI 绘画之旅。

效果展示:

--Collection集合体系)

)